Retroscena

Perché il riconoscimento automatico dei contenuti IA non funziona

di David Lee

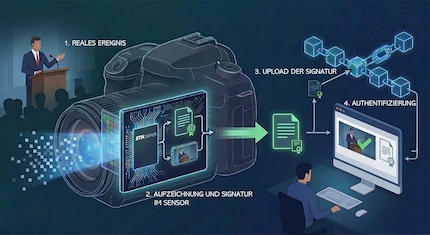

Un progetto del Politecnico di Zurigo sta aggiungendo una firma crittografica a foto e video a livello hardware. In seguito, questa dovrebbe poter essere letta in modo decentralizzato. Ciò consentirebbe alle piattaforme di verificare automaticamente le registrazioni autentiche.

Video e immagini false di politici, celebrità o del Papa: i deepfake non sono più un espediente tecnico, ma un modello di business per le frodi e un rischio per la democrazia. La disinformazione e la disinformazione sono in aumento, mentre le contromisure riescono a malapena a tenere il passo. Di conseguenza, molte persone non si fidano più nemmeno delle fonti credibili.

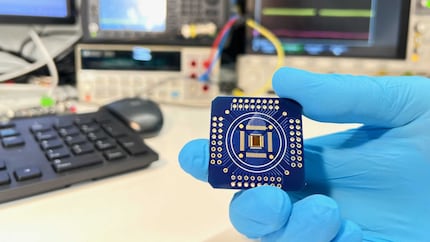

I ricercatori del Politecnico di Zurigo vogliono contrastare questo problema con una soluzione hardware. Hanno sviluppato un sensore di immagini che firma crittograficamente i suoi dati direttamente nel chip, rendendo così visibili le successive manipolazioni. Le immagini autentiche possono essere verificate da chiunque e da tutti.

Il prototipo non genera solo i dati dell'immagine per una registrazione video, ma anche una firma digitale. Questa è collegata in modo permanente al rispettivo sensore. Documenta da quale chip provengono i dati e quando sono stati creati. Qualsiasi modifica successiva al materiale dell'immagine invaliderebbe la firma. Per creare un deepfake che passi per «autentico», gli aggressori dovrebbero compromettere l'hardware stesso, cioè attaccare fisicamente il chip. Lo sforzo sarebbe così elevato che la contraffazione diventerebbe economicamente poco attraente per i social media.

I produttori di telecamere potrebbero memorizzare le firme generate dal chip in un registro pubblico su base blockchain. Le piattaforme o gli strumenti di verifica confrontano la firma del file con il registro durante il caricamento o la verifica. Se corrisponde, il contenuto è considerato una registrazione autentica. Se la voce manca o non corrisponde, si tratta di un segnale di allarme. La catena della fiducia dovrebbe quindi spostarsi dalle piattaforme e dai software all'hardware.

Gli attuali metodi di rilevamento di solito cercano i falsi sulla base di tracce di generazione dell'IA nell'immagine, come artefatti innaturali o condizioni di illuminazione incoerenti. L'approccio di ETH, invece, non lavora con le probabilità, ma con una prova affidabile dell'origine. Per piattaforme come YouTube o i social network, che stanno già testando sistemi di segnalazione di deepfake per politici e giornalisti, il chip potrebbe verificare automaticamente i contenuti.

Il sensore è ancora un prototipo. Il concetto funziona per qualsiasi tipo di sensore, dalle fotocamere agli smartphone. Per un uso diffuso, i produttori dovrebbero adattare i loro dispositivi e concordare standard di registro comuni. Resta da vedere se questo sia realistico. Finora produttori come Sony, Canon, Adobe e Microsoft hanno adottato un approccio basato sul software per verificare l'autenticità delle foto: C2PA è uno standard aperto per la firma crittografica dei metadati. Alcune fotocamere lo supportano già.

La soluzione ETH va più in profondità. Trasferisce la generazione della firma al chip e quindi collega l'evento reale con il file digitale a livello hardware. I dati grezzi e la firma sono inestricabilmente legati. La seconda differenza sta nell'idea del registro decentralizzato. Ciò significa che non è importante se un'azienda coinvolta nell'elaborazione o nella trasmissione dei dati sia affidabile.

Le mie impronte digitali cambiano talmente spesso che il mio MacBook non le riconosce più. Il motivo? Se non sono seduto davanti a uno schermo o in piedi dietro a una telecamera, probabilmente mi trovo appeso a una parete di roccia mantenendomi con i polpastrelli.

Dal nuovo iPhone al revival della moda anni '80. La redazione fa chiarezza.

Visualizza tutti